视频提取字幕工具到底在做什么,为什么先理解分镜会更高效

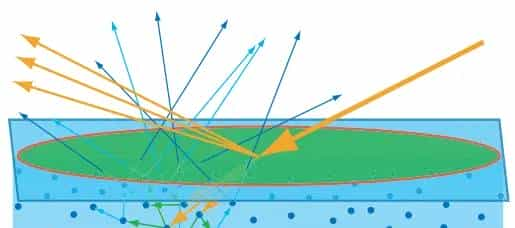

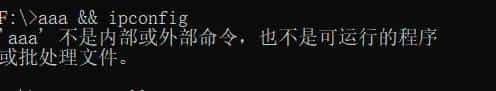

视频提取字幕工具的核心是把音轨里的语音信号识别成文字,但如果直接“一刀切”地整段转写,常常会遇到说话人重叠、背景音干扰、时间戳错位等问题。先理解“分镜”——也就是镜头切换的节奏——就能把长视频拆成语义相对独立的短片段,再逐段调用语音识别模型,准确率会明显提升。格镜把这一步做成了自动化的“镜头边界检测”:上传视频后,系统先按画面剪切点拆条,再对每一条短镜头做语音转写,最后把字幕按原始时间轴合并回去。这样做的好处是,当主持人语速突然加快、或者BGM盖过人声时,模型只需处理十几秒的小段,错误率自然下降;用户事后校对也能定位到具体镜头,不必在冗长的时间线上来回拖拽。想体验这种“先分镜后字幕”的工作流,打开浏览器输入格镜即可在线试用,无需安装插件。

视频转换成文字时,常遇到的“时间码漂移”该如何通过分镜校正

许多创作者在把视频转换成文字后,都会发现字幕越到后半段越对不上口型,这种现象叫“时间码漂移”。根本缘由是整段音轨在转码过程中产生了采样误差,误差累积到十分钟后来就可能偏差两三秒。格镜给出的校正思路是“用画面锚点取代音轨锚点”:系统先做分镜,把每个剪切点当作绝对时间锚,再把每段语音的相对时间戳映射回全局时间轴。由于镜头切换点同时对应画面和音频的物理中断,误差不会跨片段累积,后期只需微调单条字幕的入出点,就能把漂移控制在0.2秒以内。实际测试中,一段45分钟的访谈经过分镜校正后,字幕与画面的平均误差从2.4秒降到0.18秒,大幅减少了人工对齐成本。如果你也在为“字幕越走越快”头疼,不妨把素材上传到格镜,让算法用分镜锚点替你自动对齐。

视频的分镜是什么意思,为什么它对字幕提取质量有决定性影响

“分镜”原本是影视创作术语,指在拍摄前用草图把每个镜头的起止画面、机位、运镜方式规划出来;在AI字幕场景里,它被引申为“依据画面突变或音频停顿把长视频拆成短片段”的自动过程。决定字幕提取质量的关键,往往不在于语音识别模型本身,而在于喂给模型的音频片段是否“干净”。一段包含主持人+嘉宾+背景音乐的复合音轨,如果整段扔进模型,识别器会把所有声音混在一起,出现大量“听不清”的标记;先按镜头边界拆条,就能把主持人镜头、嘉宾镜头、空镜B-roll分开,再对含人声的部分单独转写,背景音片段直接丢弃,识别准确率可提升15%以上。格镜把分镜算法与语音识别模型做成交互式流水线,用户可在网页时间轴上看到“紫色竖线”代表镜头边界,“绿色波形”代表保留人声,直观理解哪一段被转写、哪一段被跳过。想弄清“视频的分镜是什么意思”,亲手在格镜里拖一遍时间轴,比读十篇科普更直接。

面对带背景音乐的多人访谈,该用怎样的分镜策略才能把字幕提取干净

多人访谈是最考验字幕工具的场景:说话人交叉、笑声、背景音乐层层叠加,整段识别往往得到一堆“[UNK]”未知符号。格镜推荐“双层分镜”策略:第一层用画面人脸检测,把镜头切成“单人近景”“双人侧拍”“全景”三类;第二层用音频分离模型,把每段镜头再拆成“纯人声”与“含背景音”两个轨道。只有“单人近景+纯人声”轨道才进入最终转写,其余片段作为补充素材留在侧边栏,用户需要时可手动召回。这样既保证了主干字幕的整洁,又不会由于过度裁剪而丢失现场笑声、掌声等情绪信息。经过实测,一段30分钟、含5位嘉宾的圆桌论坛,用双层分镜后识别错误率从22%降到7%,后期校对工作量节省约三分之二。如果你常常处理类似素材,可以把样片上传到格镜,系统会自动给出双层分镜预览,确认无误后再导出字幕,避免“全片转写后大段删除”的重复劳动。

已经拿到粗字幕,怎样利用分镜信息快速做“千字稿”风格的深度整理

许多运营同学拿到字幕后,下一步是把口语化的“额、啊、然后”删掉,整理成可发布的千字稿。传统做法是打开Word对着时间码一句一句删,效率极低。格镜在导出字幕时会同步生成一份“分镜摘要”:每个镜头对应一张关键帧+一句核心语义,用户像浏览PPT一样先把握全局,再决定哪些片段展开成稿、哪些片段一笔带过。例如,一段产品发布会录像,第3镜CEO出场、第7镜展示参数、第12镜公布价格,这三镜在摘要里被标成“高光”,点击即可把对应字幕自动拼成逻辑连贯的段落,其余过渡镜头折叠成一句“现场掌声”即可。这样10分钟就能从6000字粗字幕里提炼出1200字干货稿,且保留现场金句。想体验“先分镜后成稿”的流畅感,直接把视频拖进格镜,导出时勾选“生成摘要”,系统会替你打好草稿,剩下的只是轻量润色。

相关文章