高效构建RAG应用的利器:开源项目LightRAG,简便快捷

在AI大模型席卷全球的当下,检索增强生成(RAG)技术已成为解决大模型“知识过时”“实际幻觉”等核心痛点的关键方案。无论是企业级的智能客服、专业领域的知识库问答,还是个人层面的信息整理工具,RAG都凭借“模型推理+外部检索”的独特优势,在各行业落地应用中占据重大地位。不过,传统RAG框架往往面临部署复杂、定制化困难、资源消耗大等问题,让许多开发者望而却步。

HKUDS 开源的 LightRAG 项目,恰好为解决这些痛点而来。作为一款轻量级、高性能的RAG框架,LightRAG以“简单易用、灵活高效”为核心设计理念,大幅降低了RAG应用的开发门槛,同时在检索精度和推理速度上展现出优异性能。该项目的开源不仅为开发者提供了强劲的技术工具,更推动了RAG技术在更广泛场景的普及与创新,具有极高的技术价值和应用意义。

简介

LightRAG 是由 HKUDS(香港大学数据科学实验室)开发并开源的轻量级检索增强生成(RAG)框架,项目代码托管于GitHub平台,仓库地址为

https://github.com/HKUDS/LightRAG。作为一款面向开发者的工具型框架,LightRAG的核心定位是“降低RAG开发门槛,提升应用部署效率”,其设计理念围绕“轻量、高效、灵活”三大关键词展开,既适用于初学者快速搭建demo,也能满足企业级应用的性能需求。

LightRAG 提供了从数据处理、检索引擎构建到生成优化的全流程RAG解决方案。其核心功能包括文档加载与解析、文本分片与嵌入、向量数据库管理、多策略检索、上下文优化以及大模型集成等。与传统 RAG 框架相比,LightRAG 在多个方面实现了突破:

- 一是轻量级架构,核心代码量精简,部署时无需复杂的集群配置,单机即可运行;

- 二是智能文本处理,支持 PDF、DOCX、TXT等多种格式文档的批量解析,内置自适应文本分片算法,能根据文档内容结构动态调整分片大小,提升检索精度;

- 三是多模态检索支持,除了文本内容外,还可扩展至图片、表格等多类型数据的检索;四是灵活的大模型适配,兼容 OpenAI、Anthropic、百度文心一言、阿里通义千问等国内外主流大模型,开发者可根据需求自由切换。

LightRAG 的灵活性使其能够适配多种行业需求。在企业服务领域,可用于构建智能客服系统,通过对接企业内部知识库,实现客户问题的精准响应,降低人工客服成本;在教育领域,教师可利用其搭建个性化学习助手,根据学生的提问从教学资料中检索相关知识点,生成针对性的讲解内容;在科研领域,研究人员可将大量文献导入系统,快速获取特定主题的相关研究成果,提升文献调研效率;在个人应用层面,开发者可基于LightRAG开发私人知识库工具,实现对个人笔记、资料的智能检索与总结。此外,LightRAG的二次开发特性还使其能够应用于医疗、法律等对精度要求极高的专业领域,通过定制检索策略和知识库,满足特定场景的严格需求。

使用

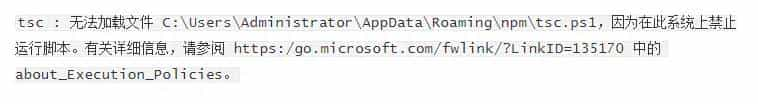

LightRAG的运行依赖Python环境和相关库,第一需要完成基础环境的部署。推荐使用Anaconda创建独立的虚拟环境,以避免依赖冲突,也可直接使用Python自带的venv模块创建虚拟环境。

激活虚拟环境后,可通过pip直接安装LightRAG框架:

pip install lightrag也可以先克隆代码到本地,然后本地安装,能够更加灵活地进行二次开发:

git clone https://github.com/HKUDS/LightRAG.git

cd LightRAG

pip install -r requirements.txt -i https://pypi.tuna.tsinghua.edu.cn/simple

pip install -e .LightRAG的配置主要围绕大模型API密钥和向量数据库展开,使用配置文件config.yaml,核心配置内容如下,根据使用的大模型进行修改:

llm:

type: "openai" # 大模型类型,支持openai、ernie、qwen等

api_key: "sk-your-openai-api-key" # 替换为你的API密钥

model_name: "gpt-3.5-turbo" # 模型名称

temperature: 0.1 # 生成温度,越低越精准

embedding:

type: "sentence_bert" # 嵌入模型类型

model_name: "all-MiniLM-L6-v2" # 嵌入模型名称

vector_db:

type: "faiss" # 向量数据库类型,支持faiss、chroma等

save_path: "./vector_db" # 向量数据库保存路径LightRAG支持多种格式的文档导入,包括TXT、PDF、DOCX、Markdown等,提供了DocumentLoader类,可批量加载并解析不同格式的文档。以常见的PDF文档为例,使用其 pdf 扩展:

from lightrag.utils.document_loader import DocumentLoader

from lightrag.utils.text_splitter import AdaptiveTextSplitter

# 1. 初始化文档加载器

loader = DocumentLoader()

# 2. 加载documents文件夹中的所有PDF文档

# 支持的格式包括:pdf、docx、txt、md,可通过extensions参数指定

documents = loader.load(

directory="./documents",

extensions=["pdf"],

recursive=False # 是否递归加载子文件夹中的文档

)

# 3. 初始化自适应文本分片器

# 自适应分片器会根据文档内容的段落结构动态调整分片大小

splitter = AdaptiveTextSplitter(

chunk_size=500, # 基础分片大小(字符数)

chunk_overlap=50, # 分片重叠部分大小

separators=["

", "

", ". ", "。 "] # 分片分隔符

)

# 4. 对文档进行分片处理

split_docs = splitter.split_documents(documents)

# 查看处理结果

print(f"原始文档数量:{len(documents)}")

print(f"分片后文档片段数量:{len(split_docs)}")

print(f"第一个片段内容:

{split_docs[0].page_content[:200]}...")执行该代码,就能完成 PDF 文档的加载与分片。

检索引擎是RAG的核心组件,LightRAG支持将分片后的文档片段转换为向量并存储到向量数据库中,同时提供多策略检索功能。编写以下代码初始化检索引擎并将文档向量存入数据库:

from lightrag.retriever import VectorRetriever

from lightrag.utils.embedding import EmbeddingModel

import yaml

from data_process import split_docs # 导入上一步处理后的文档片段

# 1. 加载配置文件

with open("./config.yaml", "r", encoding="utf-8") as f:

config = yaml.safe_load(f)

# 2. 初始化嵌入模型

embedding_model = EmbeddingModel(

model_type=config["embedding"]["type"],

model_name=config["embedding"]["model_name"]

)

# 3. 初始化向量检索器

retriever = VectorRetriever(

embedding_model=embedding_model,

vector_db_type=config["vector_db"]["type"],

vector_db_save_path=config["vector_db"]["save_path"]

)

# 4. 将文档片段存入向量数据库

# 若数据库已存在,会自动增量添加新的文档片段

retriever.add_documents(split_docs)

# 5. 保存检索引擎配置

retriever.save("./retriever_config.json")

print("检索引擎构建完成!")

print(f"向量数据库已保存至:{config['vector_db']['save_path']}")完成检索引擎的构建后,即可结合大模型开发完整的RAG生成应用,实现“检索→生成”的全流程闭环:

from lightrag.rag import RAGPipeline

from lightrag.llm import LLMClient

from lightrag.retriever import VectorRetriever

import yaml

# 1. 加载配置文件

with open("./config.yaml", "r", encoding="utf-8") as f:

config = yaml.safe_load(f)

# 2. 初始化大模型客户端

llm_client = LLMClient(

llm_type=config["llm"]["type"],

api_key=config["llm"]["api_key"],

model_name=config["llm"]["model_name"],

temperature=config["llm"]["temperature"],

# 若使用百度文心一言,需添加secret_key参数

# secret_key=config["llm"]["secret_key"]

)

# 3. 加载已构建的检索引擎

retriever = VectorRetriever.load(

embedding_model_config=config["embedding"],

retriever_config_path="./retriever_config.json"

)

# 4. 初始化RAG管道

rag_pipeline = RAGPipeline(

llm_client=llm_client,

retriever=retriever,

# 配置生成提示词模板

prompt_template="""请基于以下参考资料,简洁、准确地回答用户的问题。

若参考资料中没有相关信息,请明确说明“未找到相关信息”,不要编造内容。

参考资料:

{context}

用户问题:{query}

回答:"""

)

# 5. 定义问答函数

def rag_qa(query):

# 执行RAG流程:检索→生成

result = rag_pipeline.run(

query=query,

top_k=3 # 检索Top3相关文档片段作为上下文

)

return result["answer"]

# 测试问答功能

if __name__ == "__main__":

while True:

user_query = input("

请输入你的问题(输入'退出'结束):")

if user_query == "退出":

break

answer = rag_qa(user_query)

print(f"

回答:

{answer}")

总结

LightRAG 作为 HKUDS 开源的轻量级RAG框架,凭借其简洁的架构设计、丰富的功能模块和高效的性能表现,为开发者构建RAG应用提供了强有力的支持。该框架的核心优势体目前多个方面:一是极低的开发门槛,通过简洁的API设计和完善的文档支持,让初学者也能快速上手;二是高度的灵活性,支持多种大模型、嵌入模型和向量数据库的适配,可根据项目需求自由组合;三是优异的检索与生成质量,内置的自适应文本分片算法和多策略检索功能,有效提升了上下文的相关性,结合大模型的精准生成能力,为用户提供可靠的回答;四是完善的扩展能力,支持批量处理、API部署等进阶功能,满足从demo开发到企业级应用部署的全流程需求。

从应用价值来看,LightRAG的开源不仅为开发者节省了RAG应用的开发时间和成本,更推动了RAG技术在各行业的普及与落地。在企业数字化转型过程中,LightRAG可协助企业快速构建智能知识库和客服系统,提升服务效率;在教育和科研领域,其能够辅助实现个性化学习和高效文献调研;在个人应用层面,为用户提供智能信息整理工具,提升信息获取效率。随着RAG技术的不断发展,LightRAG社区的持续壮大,信任该框架会不断迭代优化,加入更多先进功能,如多模态RAG、实时数据检索等,为AI应用的开发带来更多可能性。对于开发者而言,无论是进行RAG技术的学习实践,还是开展实际项目开发,LightRAG都是一个值得深入探索和使用的优秀开源项目。

相关文章