Claude 被难哭!Cursor 新评测基准,敢说比 SWE-Bench 更真实?

编程智能体时代,评测标准要变了。

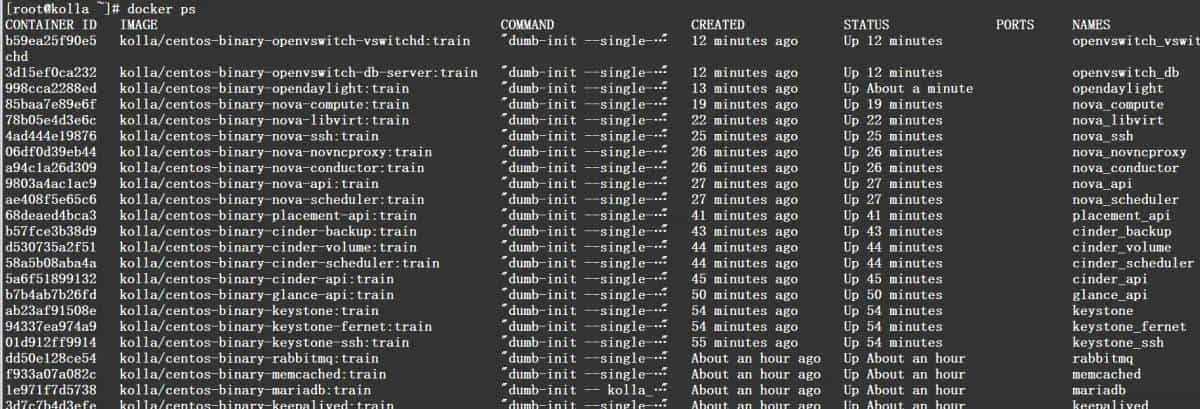

就在刚刚,Cursor 发布了自己的评测基准 CursorBench。结果挺有意思——曾在 SWE-Bench 上表现亮眼的 Claude Haiku 4.5/Sonnet 4.5,这次成绩不太理想。

说实话,这个结果我一点不意外。

由于 CursorBench 和其他编程基准,根本就不是一回事。

先说结论:**CursorBench 更贴近真实开发场景。**

SWE-Bench 什么问题?

任务太单一,主要是修复 GitHub issue 的 bug。但现实开发中,开发者会要求 AI 修改多个文件、分析生产日志、运行实验……比基准复杂多了。

Cursor 这次的设计,有 3 个点挺有意思:

1. 任务来自真实用户

以前的基准是”刻意找题”,找 GitHub issue、找各种谜题。

CursorBench 的题来自自家平台的真实用户数据。通过 Cursor Blame 工具,他们可以追踪某一段代码是由哪个 AI 请求生成的。

这就构成了绝佳的”出题范本”。

2. 任务规模更大

如今用 Cursor 的人太多了,所以 CursorBench 的任务规模明显更大。

从代码行数和平均文件数来看,问题规模从初始版本到当前的 CursorBench-3 大致翻了一倍。

3. 任务描述刻意保持”模糊”

许多公开基准里的任务描述超级详细,但现实中大家和 AI 说话时往往模棱两可。

太精准反而与真实相悖。

还有个亮点——**线上 + 线下混合评测**。

线下就是 CursorBench,让不同模型完成同一批标准任务,从正确性、代码质量、效率、交互行为等维度打分。

线上更直接——A/B Test,看真实用户使用效果。

观察开发者是否接受 AI 生成的代码、是否继续追问、是否撤销修改、任务是否真正完成。

这样一来,线下先快速筛选模型能力,然后线上验证模型是否真的更好,发现偏差后再去调整 benchmark 或模型。

飞轮效应这不就起来了。

最后说两句。

CursorBench 在前沿模型之间的区分度明显更高。

基准一饱和,模型们往往拉不开差距,大家分都高。但一遇到新的、难的,实力差距便自然显露了。

只需对比模型在 SWE-Bench 和 CursorBench 上的得分就能看出来——左边全挤在一起、右边呈阶梯式。

以及 Cursor 还强调了一点——CursorBench 的排名,与真实用户体验更加一致。

──────────────────────────────────────────────────

你觉得新的评测基准,能服众吗?

评论区聊聊��

#AI 编程 #Cursor #Claude #SWE-Bench

相关文章